小米は、視覚認識・音声・ロボット制御を統合した47億パラメータのAIモデルを開発しました

小米はロボット工学市場へ参入

モバイルデバイスとスマートホームの中国大手である小米(Xiaomi)は、ロボット用独自AIモデル開発に踏み出したことを発表しました。会社はオープンソースのXiaomi‑Robotics‑0システムを公開し、視覚認識・言語理解・リアルタイム行動制御を統合しています。このモデルは47億パラメータを持ち、シミュレーションと実際のテストで複数の記録を樹立しました。

モデルの仕組み

ロボットは通常「知覚 → 判断 → 行動」のサイクルを経ます。Xiaomi‑Robotics‑0はMixture‑of‑Transformers(MoT)アーキテクチャにより、広範な状況理解と正確なモーター制御のバランスを取ります。

1. 視覚言語モデル(VLM) – システムの「頭脳」

* 「タオルを折ってください」のような曖昧な指示も解釈可能。

* 高品質画像に基づく空間関係を理解。

* タスク:物体検出、視覚質問への回答、論理推論。

2. 行動エキスパート(Action Expert) – 動作生成器

* 拡散トランスフォーマー(DiT)に基づく。

* 一度に一つの行動を生成せず、フロー比較で連続的かつ正確な行動列を形成。

理解喪失なしの学習

従来のVLMは物理タスク学習時に知覚スキルを失うことがあります。小米は画像+テキストと行動データを同時に用いてモデルを訓練し、以下の段階で学習します。

1. 行動提案 – VLMが画像ごとの可能な行動分布を予測し、内部表現を実際操作と同期。

2. その後VLMは「オフ」になり、DiTはノイズから正確なシーケンス生成を別途学習。言語トークンではなくキーフィーチャに依存。

遅延最小化

モデル予測とロボット実動の間の停止を排除するため、AI計算とロボット行動を非同期で出力します。これにより追加計算が必要な場合でも連続的に動作可能です。

* Clean Action Prefix – 以前に予測した行動を復元し、スムーズさを確保。

* 注意マスクは現在の視覚列に焦点を当て、過去状態を無視することで環境変化への即応性を向上。

成果

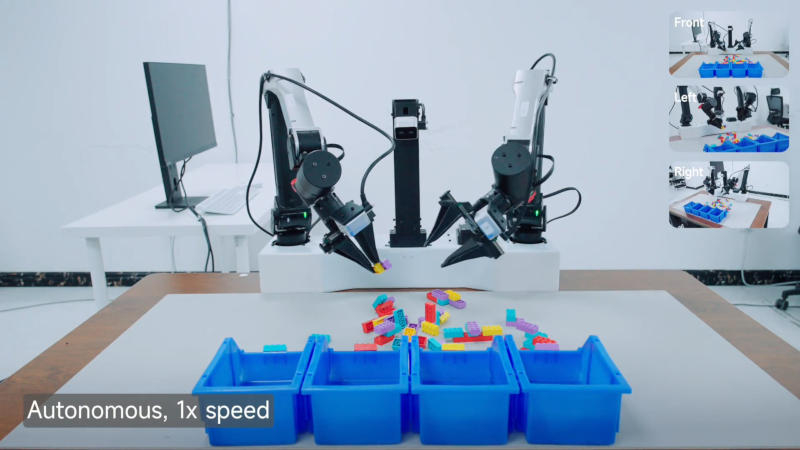

LIBERO、CALVIN、SimplerEnv のシミュレーション環境でXiaomi‑Robotics‑0は約30社の競合を上回りました。二つのマニピュレータを備えた実機ではタオル折りや構造玩具分解など複雑な課題に成功。ロボットは手と目の協調性を維持し、さまざまなシナリオで一貫して物体操作が可能でした。

このように、小米は製品ポートフォリオを拡大しただけでなく、「物理インテリジェンス」ロボット研究の基盤も築きました

Asted Cloud

Asted Cloud

コメント (0)

感想を共有してください。礼儀正しく、話題に沿ってお願いします。

コメントするにはログイン