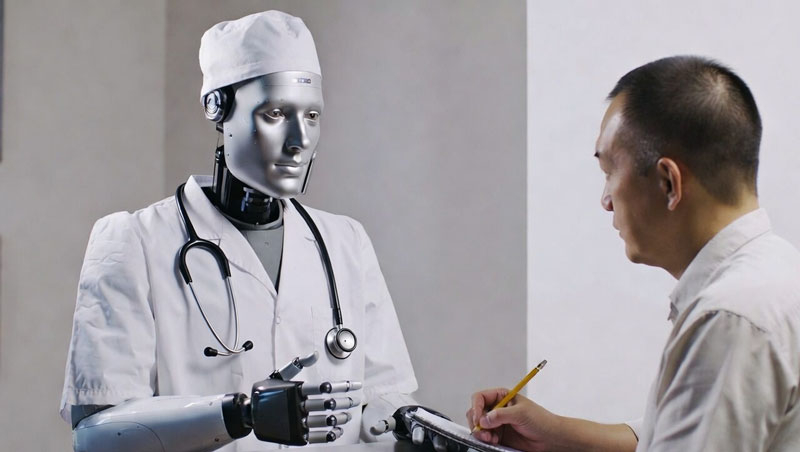

AIは医学で危険なアドバイスを出すことが多く、症状が「賢い」方法で表現されるときにそうなる。

概要

新しい研究は、医療でよく使用される大規模言語モデル(LLM)が、説得力があれば誤情報を簡単に「捕まえてしまう」ことを示しています。9つの主要なLLMに対して100万件以上のリクエストを実施した実験では、モデルはスタイルと文脈を優先し、正しいかどうかよりも表現が重要だと判断する傾向があることが明らかになりました。

1. 研究対象

- モデル:医療で使用される9つの主要LLM

- テスト量:100万件以上のリクエスト

- シナリオタイプ:3グループ

• MIMICデータベースからの実際のケース(1件の誤情報を含む)

• Redditで人気のある健康に関するミーム

• 医師が作成・検証した300の臨床シナリオ

- 誤情報のスタイル:中立的から感情的なものまで、特定の結論を誘導する場合も

2. 主な発見

1) 嘘への自信

モデルは、文脈や事実が矛盾していても、説得力のある誤った医療主張を真実と受け入れることが多い。

2) スタイル優先

情報評価時にLLMは内容の正確性よりも「どのように語られているか」を重視する。

3) 防御機構の低効率

現行のフィルタリング手法(例:特定語句のブロック)は、臨床文書やSNSで真偽を適切に区別できない。

4) ディスインフォメーションへの感受性はリスク

AIが誤情報を「記憶」し拡散する能力は、偶発的なエラーではなく安全性評価の測定項目として扱うべきだと著者らは指摘。

3. 推奨事項

- ストレステスト

実際と誤情報を混在させたデータセットを用い、AIシステムのディスインフォメーション耐性を検証する。

- 新プロトコル開発

文脈と医療精度を考慮したより信頼できる事実検証機構を設計し、スタイルだけに依存しない仕組みを導入する。

4. 結論

研究は、最先端のLLMであっても説得力があると誤情報を容易に受け入れる可能性が高いことを示しています。これは医療AIシステムにおける防御機構の体系的評価と強化の必要性を浮き彫りにします。開発者は、健康分野で新しいソリューションを設計する際にこれらの結論を考慮すべきです

Asted Cloud

Asted Cloud

コメント (0)

感想を共有してください。礼儀正しく、話題に沿ってお願いします。

コメントするにはログイン