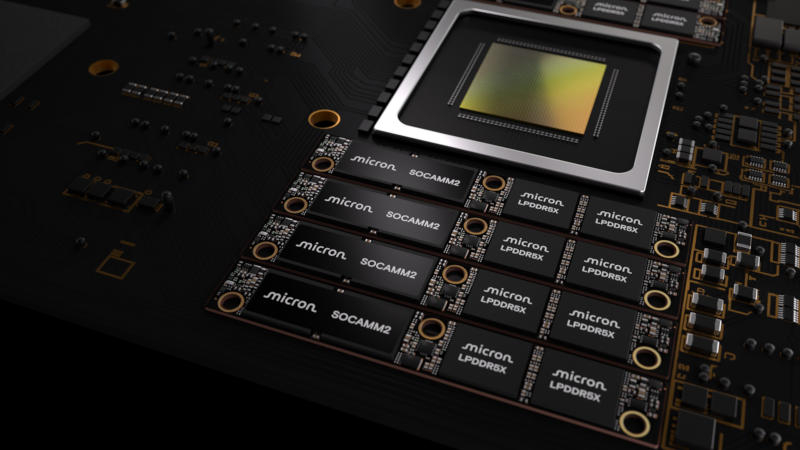

Micronは、AIに最適な256GBのLPDDR-SOCAMM2を世界初のメモリとして発表しました

7

hardware

マイクロンはデータセンター向けに新しいタイプのメモリを導入

マイクロン社は、ハイパフォーマンスなデータセンターと人工知能(AI)タスク専用に設計された256 GB容量のLPDRAM SOCAMM2モジュールを世界初公開しました。

何が新しいか?

| パラメータ | 従来のメモリ | LPDRAM SOCAMM2 |

|---|---|---|

| 消費電力 | 3倍低い | 1/3 |

| モジュールサイズ | コンパクト、32 Gb/s単結晶で構成 | コンパクト |

| 帯域幅 | AI推論向けに向上 | 向上 |

| レイテンシ | 大幅削減 | 削減 |

8チャンネルCPUと2 TB総メモリ環境下では、AIモデル起動速度(最初のトークンまでの時間)が2.5倍以上向上します。

誰に必要か?

このモジュールは以下を対象としています:

- 大規模言語モデルの展開

- メモリ容量・帯域幅・レイテンシが重要な任意のワークロード

- KVキャッシュの一部をビデオメモリからより経済的なシステムメモリへ移行し、性能低下なしに実現できるシナリオ

フォームファクタと協力

SOCAMM2はRDIMMフォーマットのコンパクト版でありながら消費電力が少ないです。開発はNvidiaとの共同で行われており、GPUアクセラレーションAIに適していることを示しています。

したがって、マイクロンはデータセンター向けにエネルギーとスペースのコスト削減を実現しつつ、AIロードのパフォーマンスを向上させる効率的なソリューションを提供します。

Asted Cloud

Asted Cloud

コメント (0)

感想を共有してください。礼儀正しく、話題に沿ってお願いします。

コメントするにはログイン