NVIDIAはGroq 3 LPUチップをリリースし、AIモデルの推論速度をトークンレベルまで加速します

NvidiaはVera Rubinプラットフォームの新機能を公開

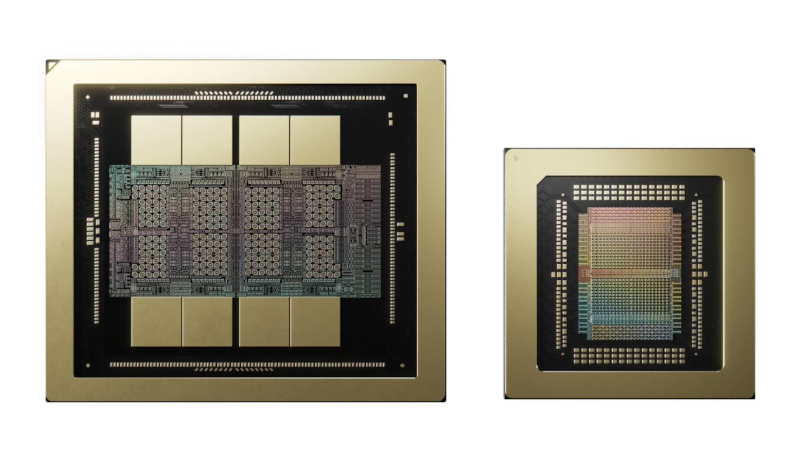

今年のGTCカンファレンスで、NvidiaのCEOジェンセン・フアンがVera Rubinプラットフォームの拡張を発表しました。新機能の基盤にはGroq社から取得した知的財産が置かれ、Rubinに*Groq 3 LPU*チップが組み込まれました。このインフェレンスアクセラレータは、高速で低遅延なトークン生成を目的としています。

Vera Rubinに既にあるもの

プラットフォームは6つの主要コンポーネントから構成され、Nvidiaはこれらをスタンドアロンシステムとして統合し、大規模AIファクトリーへスケールアップします:

| コンポーネント | 説明 |

|---|---|

| GPU Rubin | 288 GB HBM4搭載のビデオカード |

| CPU Vera | 中央処理装置 |

| NVLink 6 | システム内スケーリング用 |

| ConnectX‑9 | インテリジェントネットワークアダプタ |

| BlueField‑4 | データ処理プロセッサ |

| Spectrum‑X | オプティカル統合付きシステム間スイッチ |

Groq 3 LPUは新しいビルディングブロックとして追加され、大規模システム展開時に使用されます。

Groq 3 LPUが際立つ理由

主な違いはメモリアーキテクチャです。ほとんどのアクセラレータがHBMを作業メモリとして使用する中、各Groq 3 LPUには500 MB SRAMが搭載されています。比較:

| パラメータ | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| 容量 | 288 GB | 0.5 GB |

| 帯域幅 | ~22 TB/s | 150 TB/s |

インフェレンスタスクで帯域幅に敏感な場合、SRAMの優位性が明らかです。これがNvidiaがGroq 3をRubinに組み込んだ理由であり、トークン生成速度を向上させるためです。

Groq 3 LPXラック

このラックには256個のGroq 3 LPUチップが搭載されており、次の性能を提供します:

- 128 GB SRAM

- 合計40 PB/s の帯域幅

- 640 TB/s のシステム内インターフェース

ハイパースケーラブルソリューション担当副社長イアン・バックは、このラックをRubinの共処理装置と呼び、モデル層ごとおよびトークンごとのデコード性能向上に寄与すると強調しました。

マルチエージェントシステムへの影響

バック氏は、Groq 3 LPXが将来のAI市場—マルチエージェントシステム—の鍵となる要素になると述べました。エージェントがチャットボットを介さずに直接データを交換する場合、応答要求は100トークン/秒から1,500+トークン/秒以上へ変化します。

競合他社と展望

本文では、Wafer‑Scale Engine(WSE)を使用し、大容量SRAMで低遅延インフェレンスを実現するCerebrasが競合として言及されています。OpenAIはすでにCerebrasを先進モデルに採用しており、優れたレイテンシーを享受しています。

バック氏はまた、Groq 3 LPUの登場がRubin CPXアクセラレータへの依存度を低減できる可能性を指摘しました。現在NvidiaはGroq 3 LPXラックとプラットフォームの統合に注力しており、両チップは大容量GDDR7メモリを必要とせずインフェレンスを強化することを目的としています。

結論:

新しいGroq 3 LPUチップとそのLPXラックは、低レイテンシーインフェレンス分野でVera Rubinを強化し、より高速なマルチエージェントAIシステムへの道を開き、Cerebrasなどの競合他社と競争します。

Asted Cloud

Asted Cloud

コメント (0)

感想を共有してください。礼儀正しく、話題に沿ってお願いします。

コメントするにはログイン